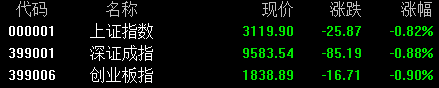

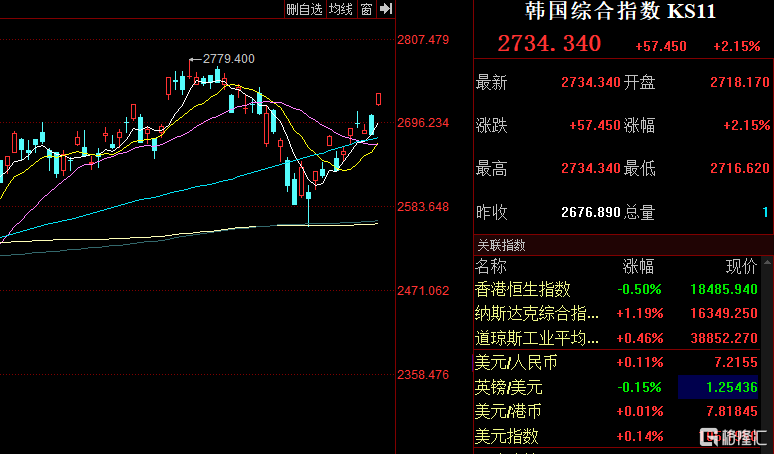

5月7日,韓國綜合指數迎“跳空”大漲,全天強勢高开高走,截至收盤,該指數收漲2.15%,報2734.34點。

消息面上,繼4月底韓國監管機構放風計劃建立後,韓國金融監督院(FSS)近期开始有新“動作”加碼對非法賣空行爲的打擊力度。

近幾個月來,隨着韓國當局採取措施打擊裸賣空,全球銀行和對衝基金的活動在韓國受到了越來越嚴格的審查。

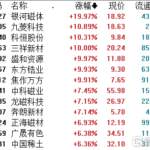

嚴打“非法賣空”!涉164只股票、9家機構

根據韓國法律,“裸賣空”,即不持有相關股票卻提前出售的行爲是非法的。

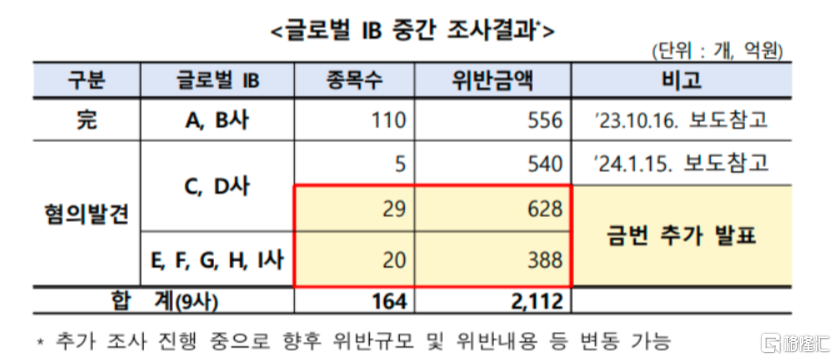

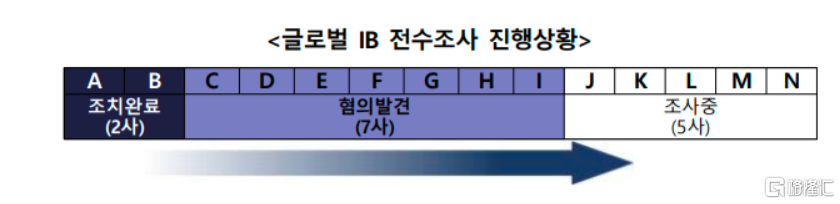

5月6日,該院發布通報稱,已發現九家全球投行在韓國股市進行了價值2112億韓元(約合1.56億美元)的非法做空交易。這些投行被指控違反了程序性規定,總計非法做空了164只股票,涉及Kakao、新羅酒店等知名企業。

瑞士信貸(CS)和野村證券涉嫌的非法賣空交易額達到1168億韓元,涉及34只股票。韓國金融監督院表示,調查尚未結束,違規金額和項目可能會進一步增加。

賣空在韓國一直是一個有爭議的政治問題,尤其是該國規模龐大的散戶投資者經常將股票下跌歸咎於賣空。

特別是針對KOSPI 200指數、KOSDAQ 150指數的成份股。此舉背景是韓國股市持續大跌,去年10月,韓國綜合指數累計跌幅達7.6%,創2022年12月以來最大的月度跌幅紀錄。

然而,賣空禁令實施後,韓國股市出現了大幅反彈,去年11月和12月的累計漲幅分別爲11.3%和4.7%,這一輪漲勢一直持續到今年3月,期間最大漲幅超過22%。

大動作不斷

韓國金融監督院表示,其目前還在繼續調查另外五家銀行,這些銀行的賣空交易規模佔海外公司在韓國賣空交易規模的90%。監管機構正在开發一個監測賣空交易的平台,以幫助識別非法交易。

韓國總統尹錫悅最近表示,在電子監控系統到位之前,禁令措施將繼續實施。此外,韓國還成立了一個特別小組,調查全球主要投資銀行自2021年5月以來的所有賣空活動。

盡管賣空在許多市場是合法的,但在韓國,由於大量散戶投資者認爲賣空是導致股價下跌的原因,賣空成爲了一個敏感的政治問題。韓國監管層的賣空禁令引發了市場的廣泛關注。一些投資者擔心,這一禁令將損害韓國市場對全球基金的吸引力。

韓國金融監督院高級副院長Hahm Yong-il表示,與總部設在美國的銀行相比,總部設在歐洲的銀行發生了更多的違規事件,而且大多數被調查的交易都是在它們位於中國香港地區的辦事處進行的。韓國金融監督院官員計劃本月晚些時候訪問香港,向全球銀行介紹韓國賣空相關法規的最新情況。

監管機構在打擊非法賣空的同時,也面臨着一些挑战。例如,开發股市做空監控系統需要時間,而且需要韓國國會的批准,因爲需要修改資本市場相關法律,以允許監管部門收集機構投資者數據。

市場對韓國監管機構的行動有不同的看法。一些分析師認爲,打擊非法賣空是維護市場秩序的必要措施,而另一些人則擔心,過於嚴格的監管可能會抑制市場的流動性和活力。

標題:韓國監管再貼臉“开大”,韓股迎大漲,當局嚴打“裸賣空”

鄭重聲明:本文版權歸原作者所有,轉載文章僅爲傳播更多信息之目的,如有侵權行爲,請第一時間聯系我們修改或刪除,多謝。